DeepSeek-V3.1 發布今天,我們正式發表DeepSeek-V3.1。本次升級包含以下主要變更:

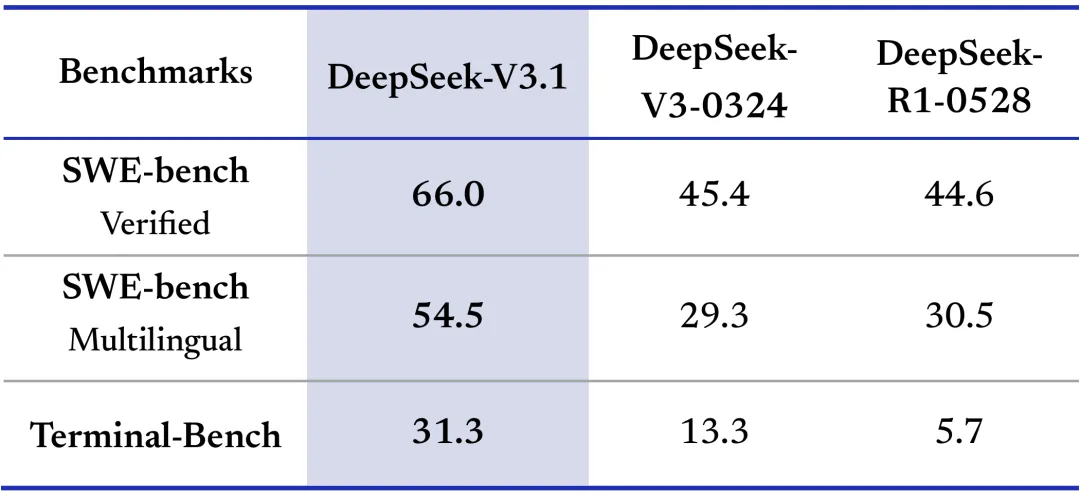

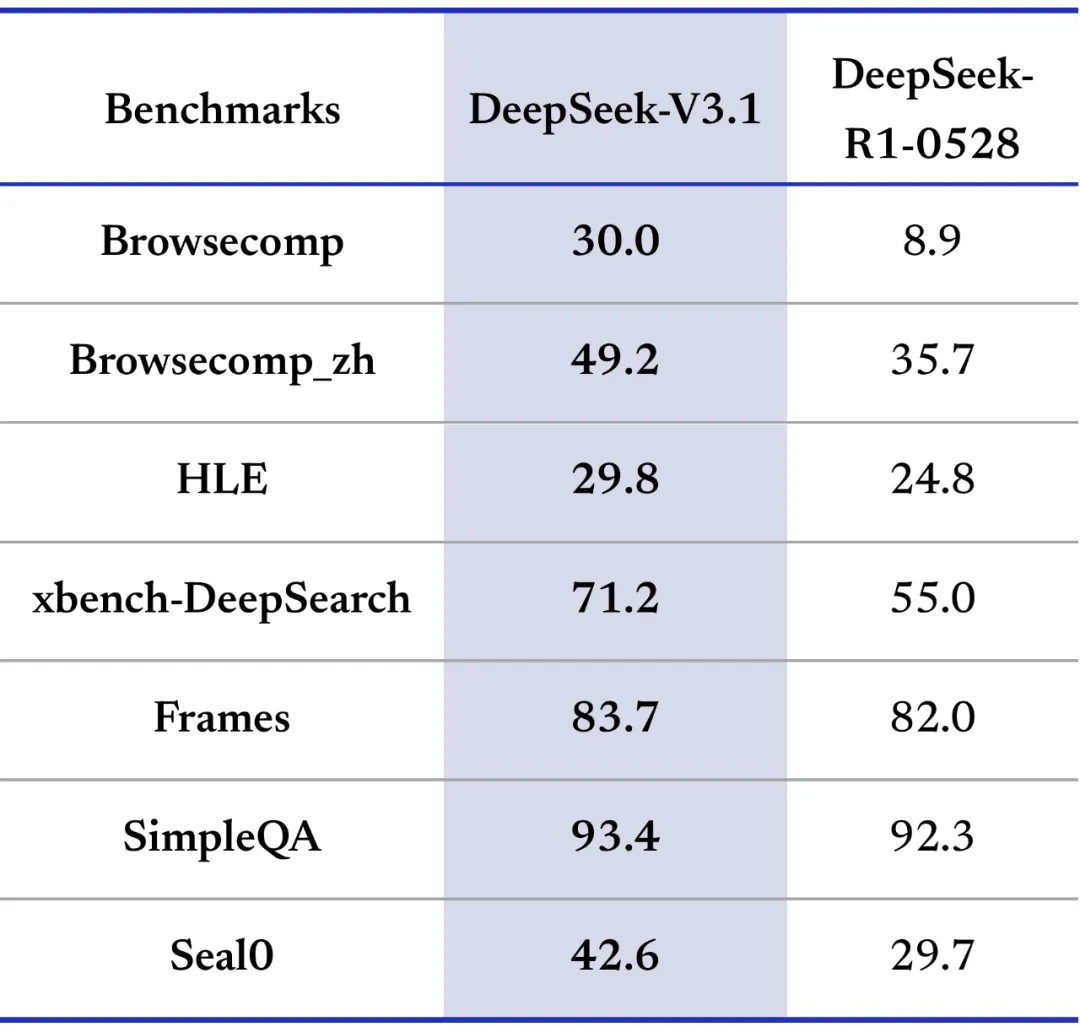

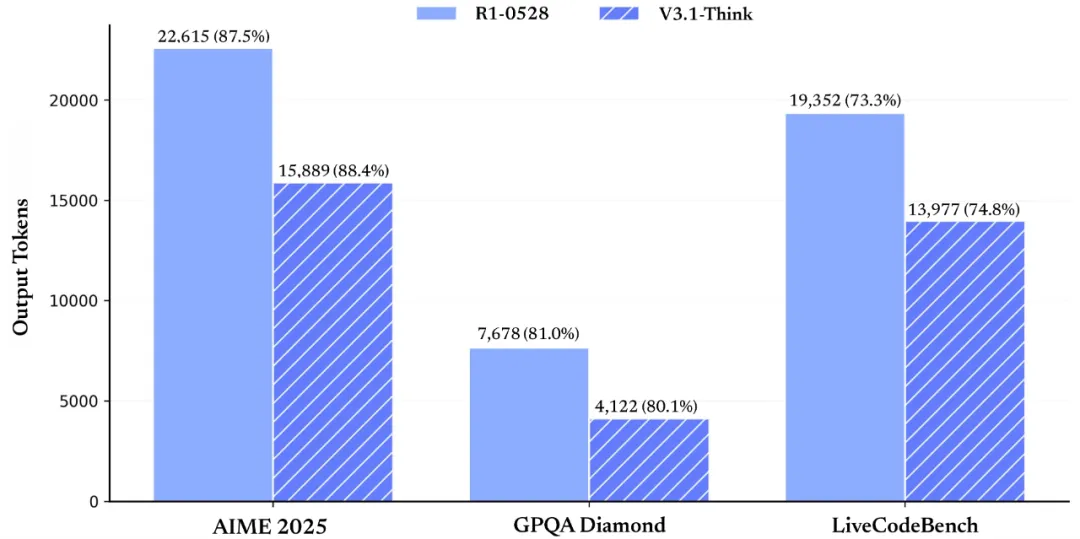

官方App 與網頁端模型已同步升級為DeepSeek-V3.1。使用者可以透過「深度思考」按鈕,實現思考模式與非思考模式的自由切換。 DeepSeek API 也已同步升級,deepseek-chat 對應非思考模式,deepseek-reasoner 對應思考模式,且上下文均已擴展為128K。同時,API Beta 介面支援了strict 模式的Function Calling,以確保輸出的Function 滿足schema 定義。詳見官方文檔 另外,我們增加了對Anthropic API 格式的支持,讓大家可以輕鬆將DeepSeek-V3.1 的能力連接到Claude Code 框架。詳見官方文檔 工具呼叫/智能體支援程式設計智能 在程式碼修復測評SWE 與命令列終端環境下的複雜任務(Terminal-Bench)測試中,DeepSeek-V3.1 相比之前的DeepSeek 系列模型有明顯提升。 搜尋智能 DeepSeek-V3.1 在多項搜尋評測指標上取得了較大提升。在需要多步驟推理的複雜搜尋測試(browsecomp)與多學科專家級難題測試(HLE)上,DeepSeek-V3.1 效能已大幅領先R1-0528。 思考效率我們的測試結果顯示,經過思維鏈壓縮訓練後,V3.1-Think 在輸出token 數減少20%-50% 的情況下,各項任務的平均表現與R1-0528 持平。  同時,V3.1 在非思考模式下的輸出長度也得到了有效控制,相比於DeepSeek-V3-0324 ,能夠在輸出長度明顯減少的情況下保持相同的模型性能。 API & 模型模型V3.1的Base 模型在V3 的基礎上重新做了外擴訓練,總共增加訓練了840B tokens。 Base 模型與後訓練模型均已在Huggingface 與魔搭開源。 Base 模型:

後訓練模型:

需要注意的是,DeepSeek-V3.1 使用了UE8M0 FP8 Scale 的參數精確度。另外,V3.1 對分詞器及chat template 進行了較大調整,與DeepSeek-V3 有明顯差異。建議有部署需求的使用者仔細閱讀新版說明文件。 價格我們將於北京時間2025 年9 月6 日凌晨起,對DeepSeek 開放平台API 介面呼叫價格進行以下調整:

在9 月6 日前,所有API 服務仍以原價保單計費,您可繼續享有當前優惠。 同時,為更能滿足使用者的呼叫需求,我們已進一步擴充API 服務資源,歡迎使用! |